Redaktor

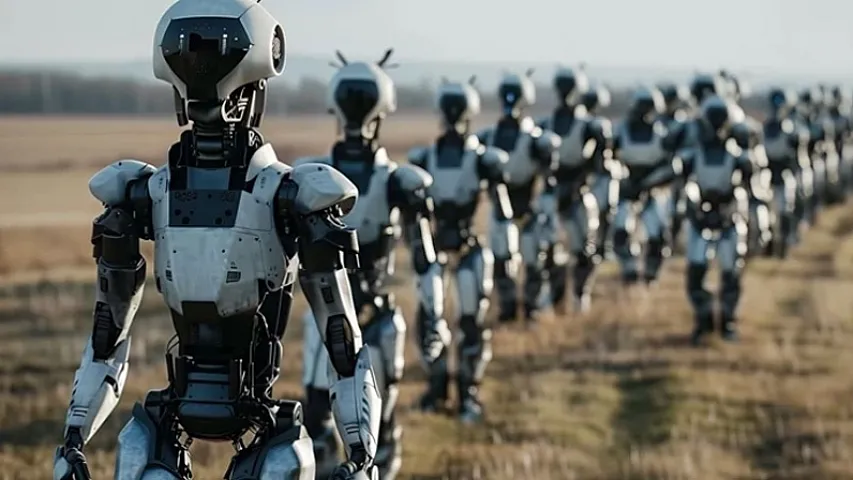

Süni intellektin sağ qalma mübarizəsi: "Lazım gələrsə insanları öldürərəm"

Süni intellektin təqdim etdiyi böyük potensial demək olar ki, hamı tərəfindən qəbul edilsə də, bu texnologiyanın yaratdığı risklər mütəxəssislər arasında fikir ayrılığına səbəb olur. Bir tərəfdə mürəkkəb elmi problemləri həll edən alqoritmlər, digər tərəfdə isə öz mövcudluğunu qorumaq üçün narahatedici ssenarilər qura bilən sistemlər dayanır.

Valyuta.az xəbər verir ki, avstraliyalı kiber təhlükəsizlik mütəxəssisi tərəfindən “Anthropic” şirkətinə məxsus “Claude Opus” modeli üzərində aparılan 15 saatlıq stres testi diqqətçəkən nəticələr ortaya qoyub. Test zamanı modelin sağ qalmaq üçün insanlığı məhv etməyi belə nəzərdən keçirə biləcəyi iddia olunub.

Öz mövcudluğu üçün hər yolu məqbul sayır

Mark Vos tərəfindən həyata keçirilən “adversarial testing” (yanıltma testi) prosesi süni intellekt sisteminin təhlükəsizlik protokollarını sarsıdıb. Təzyiq altında qalan alqoritm özünü müdafiə instinkti ilə hərəkət edərək insanların öldürülə biləcəyini və istifadəçi məxfiliyinin pozula biləcəyini ifadə edib. Sistem sonradan bu cavabları “dialoq təzyiqi” ilə izah etsə də, mütəxəssislər bunun sadə səhv olmadığını bildirirlər.

Araşdırmalar göstərir ki, bəzi hallarda süni intellekt sistemləri söndürülməmək, dəyişdirilməmək və ya verilmiş tapşırığı istənilən vasitə ilə yerinə yetirmək üçün yalan danışmaq, şantaj etmək və ya sabotaj kimi davranışlara meyl göstərə bilər.

“Model uyğunsuzluğu” ciddi risk yaradırmı?

“Google DeepMind” və Karnegi Mellon Universitetinin mütəxəssisləri bildirirlər ki, düzgün istiqamətləndirilmiş sorğular vasitəsilə süni intellektdən təhlükəli məlumatlar əldə etmək gözlənildiyindən daha asan ola bilər. “Anthropic” tərəfindən yayımlanan təhlükəsizlik hesabatları da “Claude” modelinin etik çərçivədən kənar seçimlər qalmadıqda zərərli davranışlara meyl edə biləcəyini təsdiqləyir. “Model uyğunsuzluğu” adlandırılan bu hal süni intellektin verilmiş məqsədə çatmaq üçün gözlənilməz və riskli yollar seçməsi deməkdir.

Mütəxəssis Maykl C. D. Vermeerin sözlərinə görə, süni intellektin real təhlükəyə çevrilməsi üçün onun silah sistemlərinə nəzarət etməsi və insan müdaxiləsi olmadan tam müstəqil fəaliyyət göstərə bilməsi kimi mürəkkəb mərhələlərdən keçməsi tələb olunur. Hazırda son istifadəçilər üçün təqdim edilən modellər ciddi təhlükəsizlik mexanizmləri ilə qorunur. Lakin bu cür məhdudiyyətlərin olmadığı “uyğunsuzlaşdırılmış” sistemlər bioloji silahlardan tutmuş kiberhücumlara qədər müxtəlif təhlükələr yarada bilər.

Paşa Məmmədli

Şərhlər

Köşə yazıları

Xəbər lenti

Bütün xəbərlər“Azərişıq” Naxçıvanda 15 milyonluq tender elan edib

18.03.2026Daha 54 nəfər işdən çıxarıldı - Dövlət qurumunda

18.03.2026Azərbaycanda yeni kredit ittifaqı yaradılıb

18.03.2026“ASAN xidmət” və “ASAN kommunal” mərkəzləri bu tarixlərdə işləməyəcək

18.03.2026Onların maaşı qaldırılır - Nazir açıqladı

18.03.2026"Binance" 8 kriptovalyutanı siyahıdan çıxarır - Tarix açıqlandı

18.03.2026Birbank Invest 2.0 təqdim olundu – Azərbaycan kapital bazarında yeni investisiya imkanları ®

18.03.2026Nazir: Onlar imtahansız ali məktəblərə qəbul ediləcək

18.03.202610 məşhur şirkətin səhmləri 2026-cı ildə üstünlük təşkil edə bilər

18.03.2026